Anthropic's สามช่วงเวลาสำคัญ: การรั่วไหลของโค้ด การเผชิญหน้ากับรัฐบาล และการนำไปใช้เป็นอาวุธ

ชื่อบทความต้นฉบับ: Anthropic: The Leak, The War, The Weapon

ผู้เขียนบทความต้นฉบับ: BuBBliK

ผู้เรียบเรียง: Peggy,BlockBeats

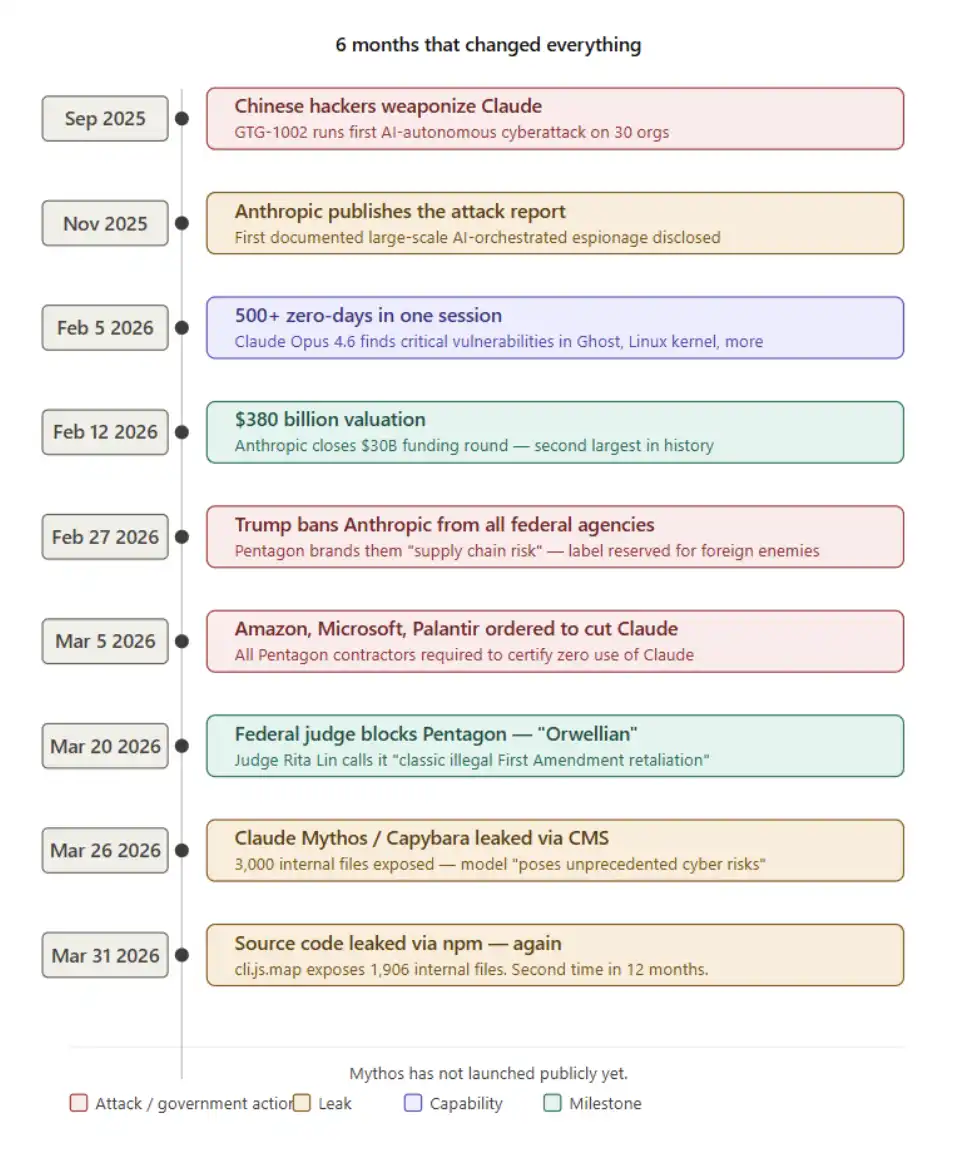

บรรณาธิการกล่าว: ในช่วงครึ่งปีที่ผ่านมา Anthropic ถูกพัวพันกับเหตุการณ์หลายอย่างที่ดูเหมือนเป็นอิสระจากกัน แต่แท้จริงแล้วชี้ไปในทิศทางเดียวกัน ได้แก่ การกระโดดก้าวของความสามารถของโมเดล การโจมตีอัตโนมัติในโลกความจริง การตอบสนองอย่างรุนแรงของตลาดทุน ความขัดแย้งแบบเปิดเผยกับรัฐบาล และการรั่วไหลของข้อมูลหลายครั้งที่เกิดจากความผิดพลาดในการตั้งค่าพื้นฐาน หากนำเบาะแสเหล่านี้มาวางรวมกัน มันจะเผยให้เห็นทิศทางการเปลี่ยนแปลงที่ชัดเจนยิ่งขึ้น

บทความนี้หยิบยกเหตุการณ์เหล่านี้มาเป็นจุดเริ่มต้น เพื่อติดตามเส้นทางต่อเนื่องของบริษัท AI หนึ่งรายในมิติของความก้าวหน้าทางเทคโนโลยี การเปิดเผยความเสี่ยง และการเผชิญหน้าด้านการกำกับดูแล อีกทั้งพยายามหาคำตอบสำหรับคำถามที่ลึกกว่า: เมื่อความสามารถในการ “ค้นหาช่องโหว่” ถูกขยายขนาดอย่างมากและค่อยๆ แผ่ขยายออกไป ระบบความปลอดภัยทางไซเบอร์เองยังคงรักษาตรรกะการทำงานเดิมได้หรือไม่

ในอดีต ความปลอดภัยตั้งอยู่บนข้อจำกัดของ “ทรัพยากรความสามารถที่หายาก” และ “ข้อจำกัดด้านกำลังคน” แต่ภายใต้เงื่อนไขใหม่ การรบระหว่างการรุกและการรับกำลังหมุนรอบชุดความสามารถของโมเดลชุดเดียวกัน ทำให้ขอบเขตยิ่งพร่ามัว ในขณะเดียวกัน การตอบสนองของระบบ ตลาด และองค์กรยังคงติดอยู่กับกรอบเดิม จึงไม่สามารถรับมือกับการเปลี่ยนแปลงนี้ได้ทันท่วงที

สิ่งที่บทความนี้ให้ความสนใจ ไม่เพียงแต่ตัว Anthropic เท่านั้น แต่ยังสะท้อนถึงความเป็นจริงที่ใหญ่กว่านี้ด้วย: AI ไม่ได้แค่เปลี่ยน “เครื่องมือ” แต่มันกำลังเปลี่ยน “เงื่อนไขที่ความปลอดภัยก่อร่างขึ้นมาอย่างไร”

ต่อไปนี้เป็นต้นฉบับ:

เมื่อบริษัทมูลค่า 380Bดอลลาร์สหรัฐ ต่อสู้เชิงอำนาจกับเพนตากอนและยืนหยัดเหนือกว่า รอดพ้นจากการโจมตีทางไซเบอร์ครั้งแรกในประวัติศาสตร์ที่เริ่มโดย AI แบบอัตโนมัติเอง และในขณะเดียวกันภายในก็รั่วไหลถึงโมเดลที่แม้แต่เหล่านักพัฒนาของตัวเองยังรู้สึกหวาดกลัว รวมถึงยัง “โดยไม่ตั้งใจ” เปิดเผยซอร์สโค้ดฉบับสมบูรณ์—ทั้งหมดนี้รวมกันแล้ว จะเป็นอย่างไร?

คำตอบคือแบบนี้อยู่แล้ว และสิ่งที่น่ากังวลยิ่งกว่านั้นก็คือ ส่วนที่อันตรายที่สุดจริงๆ อาจยังไม่เคยเกิดขึ้น

สรุปเหตุการณ์

Anthropic รั่วไหลโค้ดของตัวเองอีกครั้ง

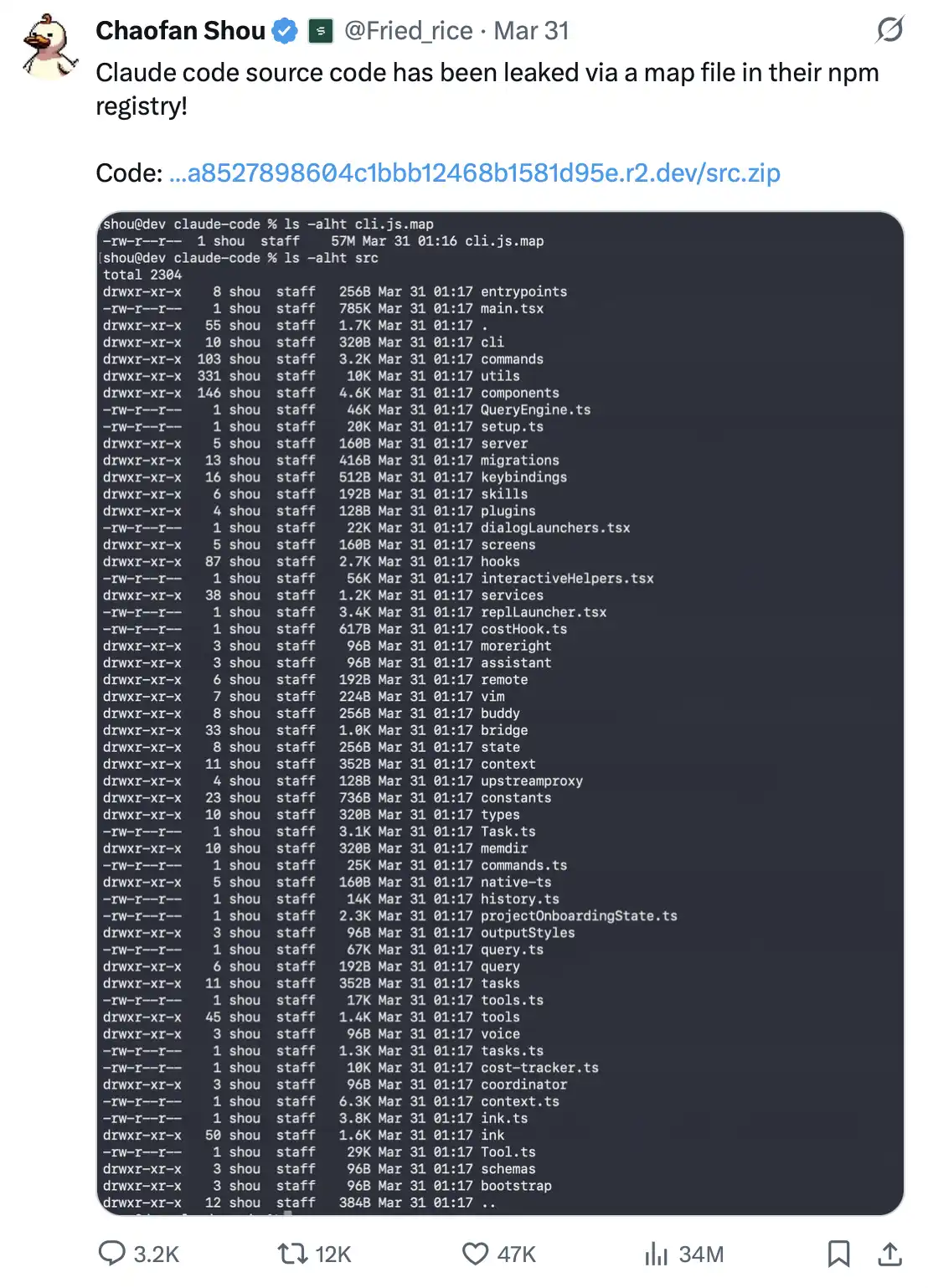

วันที่ 31 มีนาคม 2026 นักวิจัยด้านความปลอดภัยของบริษัทบล็อกเชน Fuzzland ชื่อ Shou Chaofan เมื่อกำลังตรวจสอบแพ็กเกจ npm Claude Code อย่างเป็นทางการ พบว่าในนั้นกลับมีไฟล์ที่ชื่อ cli.js.map อยู่ในรูปแบบข้อความชัดเจน

ไฟล์นี้มีขนาดถึง 60MB และเนื้อหาก็ยิ่งน่าตกใจยิ่งกว่า มันแทบจะมีซอร์สโค้ด TypeScript ฉบับสมบูรณ์ของผลิตภัณฑ์ทั้งหมดอยู่ในนั้น เพียงแค่ไฟล์เดียวนี้ก็ทำให้ทุกคนสามารถย้อนกลับไปได้ถึงไฟล์ซอร์สโค้ดภายในมากถึง 1906 ไฟล์ รวมถึงการออกแบบ API ภายใน ระบบเทเลเมทรี เครื่องมือเข้ารหัส ลอจิกด้านความปลอดภัย ระบบปลั๊กอิน—แทบจะเห็นองค์ประกอบหลักทั้งหมดอย่างครบถ้วน ที่สำคัญคือ เนื้อหาเหล่านี้ยังสามารถดาวน์โหลดจากบัคเก็ตจัดเก็บ R2 ของ Anthropic เองโดยตรงเป็นไฟล์ zip ได้ด้วย

การค้นพบนี้แพร่กระจายอย่างรวดเร็วบนโซเชียลมีเดีย: ภายในไม่กี่ชั่วโมง โพสต์ที่เกี่ยวข้องมีผู้เข้าชม 754k ครั้ง และมีการแชร์ต่อเกือบ 1000 ครั้ง ขณะเดียวกันก็มีการสร้างและเปิดเผยที่เก็บ GitHub หลายแห่งที่นำซอร์สโค้ดกลับมาด้วยทันที

ที่เรียกว่า source map (ไฟล์แมประหว่างซอร์ส) โดยแก่นแท้แล้วเป็นเพียงไฟล์ช่วยสำหรับการดีบัก JavaScript หน้าที่ของมันคือการคืนโค้ดที่ถูกบีบอัดและคอมไพล์กลับไปเป็นซอร์สโค้ดดั้งเดิม เพื่อให้ผู้พัฒนาใช้ในการตรวจหาปัญหา

แต่มีหลักการพื้นฐานข้อหนึ่ง: มันไม่ควรอยู่ในแพ็กเกจที่เผยแพร่ในสภาพแวดล้อมการผลิต

นี่ไม่ใช่เทคนิคการโจมตีขั้นสูงอะไร เป็นแค่ปัญหาด้านมาตรฐานเชิงวิศวกรรมที่พื้นฐานที่สุด อยู่ในหมวด “บทเรียนเบื้องต้นเรื่องการตั้งค่าการบิลด์ 101” และแม้แต่สิ่งที่นักพัฒนาจะได้เรียนกันในสัปดาห์แรกด้วยซ้ำ ถ้าเกิดความผิดพลาดและแพ็กเข้าไปในสภาพแวดล้อมการผลิต source map มักจะเท่ากับการ “แถม” ซอร์สโค้ดให้กับทุกคนโดยตรง

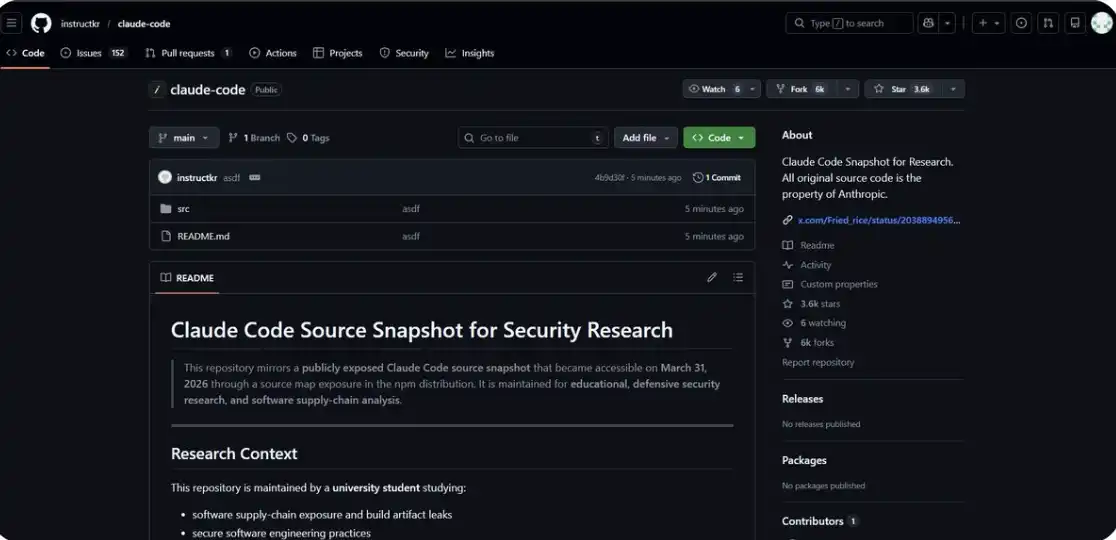

คุณสามารถดูโค้ดที่เกี่ยวข้องได้โดยตรงที่นี่เช่นกัน: https://github.com/instructkr/claude-code

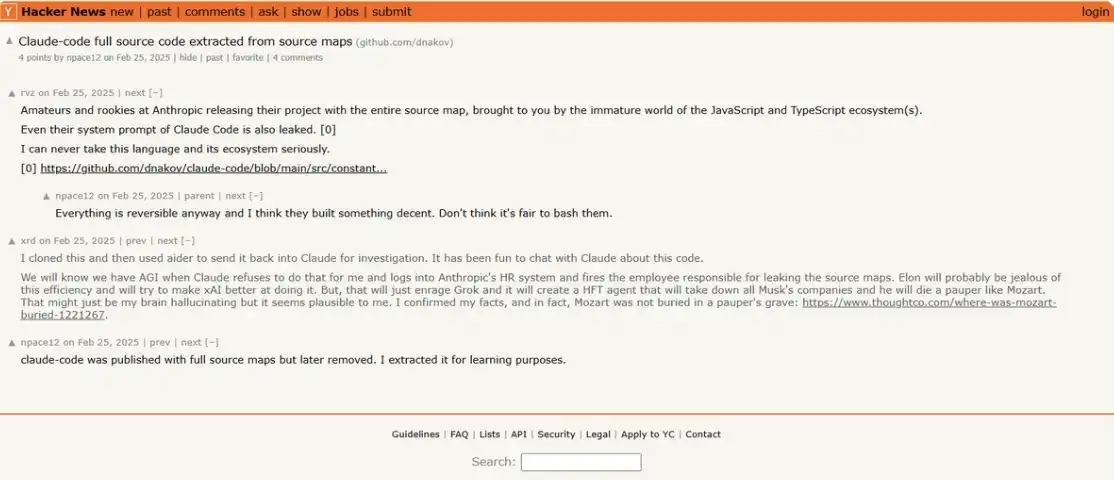

แต่สิ่งที่ทำให้เรื่องนี้ดูน่าขันที่สุดคือ: มันเคยเกิดขึ้นมาแล้วครั้งหนึ่ง

ในเดือนกุมภาพันธ์ 2025 ซึ่งเป็นเมื่อเกือบหนึ่งปีก่อน เหตุการณ์แบบเดียวกันแทบทุกอย่างก็เกิดขึ้นแล้ว: ไฟล์เดียวกัน ความผิดพลาดแบบเดียวกัน Anthropic ในตอนนั้นได้ลบเวอร์ชันเก่าออกจาก npm เอา source map ออก และเผยแพร่ว่ารุ่นใหม่อีกครั้ง เรื่องก็สงบลง

แต่ในเวอร์ชัน v2.1.88 ไฟล์นี้ถูกแพ็กและเผยแพร่อีกครั้ง

บริษัทที่มีมูลค่า 754kดอลลาร์สหรัฐ และกำลังสร้างระบบตรวจจับช่องโหว่ที่ล้ำหน้าที่สุดในโลก กลับทำผิดพลาดพื้นฐานเดิมแบบเดียวกันสองครั้งภายในหนึ่งปี ไม่มีการเจาะระบบ ไม่มีกระบวนการใช้ประโยชน์ที่ซับซ้อน เพียงแค่กระบวนการสร้างที่ควรจะทำงานได้ตามปกติกลับมีปัญหา

ความประชดประชันแบบนี้แทบจะมีความ “เป็นกวี” อยู่ในตัว

AI ที่สามารถค้นพบ 500 ช่องโหว่ศูนย์วันได้ในการรันครั้งเดียว; โมเดลที่ถูกนำไปใช้เพื่อโจมตีอัตโนมัติหน่วยงาน 30 แห่งทั่วโลก—และในขณะเดียวกัน Anthropic กลับ “แพ็กแถม” ซอร์สโค้ดของตัวเองให้คนที่แค่อยากเปิดดูแพ็กเกจบน npm เท่านั้น

สองครั้งที่รั่วไหล โดยห่างกันไม่ถึงเจ็ดวัน

สาเหตุกลับเหมือนกันทุกประการ: ความผิดพลาดในการตั้งค่าที่พื้นฐานที่สุด ไม่ต้องมีความรู้เชิงเทคนิคใดๆ และไม่ต้องมีเส้นทางการโจมตีที่ซับซ้อน แค่รู้ว่าจะไปดูที่ไหน คนก็สามารถรับมันได้ฟรี

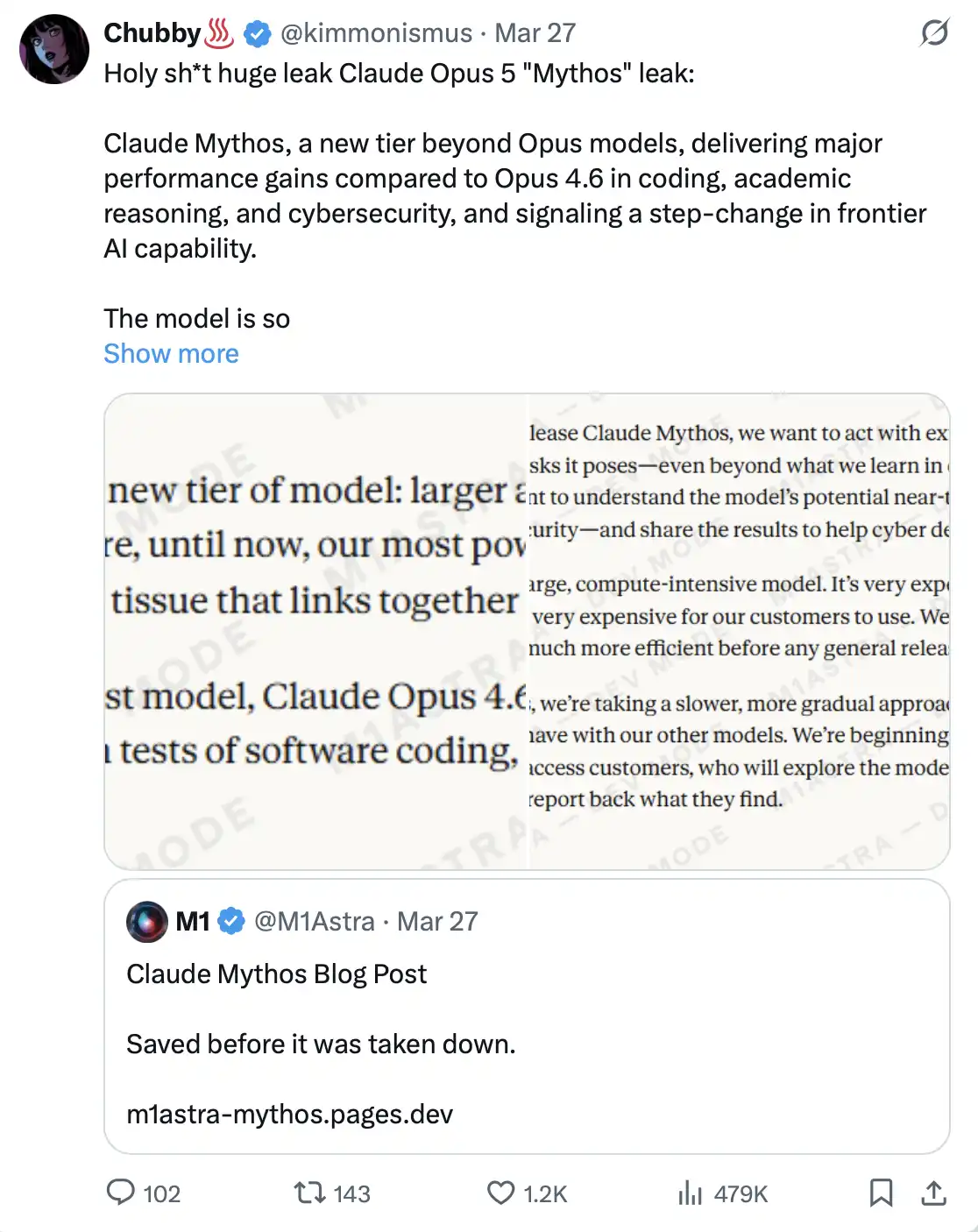

เมื่อหนึ่งสัปดาห์ก่อน: การเปิดเผยโดยไม่ตั้งใจของ “โมเดลอันตราย” ภายใน

วันที่ 26 มีนาคม 2026 นักวิจัยด้านความปลอดภัย Roy Paz จาก LayerX Security และ Alexandre Pauwels จาก University of Cambridge พบว่าในการตั้งค่า CMS ของเว็บไซต์ทางการของ Anthropic มีปัญหา ส่งผลให้มีไฟล์ภายในราว 3000 ชุดถูกเปิดให้เข้าถึงสาธารณะ

ไฟล์เหล่านี้ได้แก่: ร่างบทความในบล็อก, PDF, เอกสารภายใน, สื่อสำหรับการนำเสนอ—ทั้งหมดถูกเปิดเผยอยู่ในที่เก็บข้อมูลที่ไม่ได้ป้องกันและสามารถค้นหาได้ ไม่มีการโจมตีโดยแฮกเกอร์ และไม่จำเป็นต้องใช้เทคนิคใดๆ

ในบรรดาไฟล์เหล่านี้ มีร่างบทความบล็อกอยู่ 2 ฉบับที่เกือบจะเหมือนกันทั้งหมด ความแตกต่างเดียวคือชื่อของโมเดล: ฉบับหนึ่งเขียนว่า “Mythos” อีกฉบับเขียนว่า “Capybara”

นั่นแปลว่า ในเวลานั้น Anthropic กำลังอยู่ระหว่างการเลือกระหว่างชื่อสองชื่อสำหรับโปรเจกต์ลับเดียวกัน บริษัทได้ยืนยันต่อมาว่า การเทรนโมเดลนี้เสร็จสิ้นแล้ว และเริ่มถูกนำไปทดสอบกับลูกค้ารายแรกๆ บางส่วนแล้ว

นี่ไม่ใช่การอัปเกรดทั่วไปของ Opus แต่เป็นโมเดลระดับ “ชั้นที่สี่” ใหม่ทั้งหมด ซึ่งมีการจัดวางไว้ในระดับที่สูงกว่าระบบของ Opus ด้วยซ้ำ

ในร่างของ Anthropic เอง มันถูกอธิบายว่า: “ใหญ่กว่าและฉลาดกว่าโมเดล Opus ของเรา—และ Opus จนถึงตอนนี้ยังคงเป็นโมเดลที่แข็งแกร่งที่สุดของเรา” ทั้งในด้านความสามารถด้านการเขียนโปรแกรม การให้เหตุผลเชิงวิชาการ และความปลอดภัยทางไซเบอร์ ก็มีการกระโดดขึ้นอย่างชัดเจน โฆษกคนหนึ่งเรียกมันว่า “การก้าวกระโดดเชิงคุณภาพ” และยังเป็น “โมเดลที่แข็งแกร่งที่สุดที่เราสร้างขึ้นจนถึงตอนนี้”

แต่สิ่งที่ควรให้ความสนใจจริงๆ ไม่ได้อยู่ที่คำอธิบายด้านประสิทธิภาพเหล่านี้

ในร่างที่รั่วไหล Anthropic ประเมินโมเดลนี้ว่า: มัน “นำความเสี่ยงด้านความปลอดภัยทางไซเบอร์ที่ไม่เคยมีมาก่อนมาให้”, “ความสามารถด้านเครือข่ายเหนือกว่าโมเดล AI อื่นๆ ใด”, และ “ส่งสัญญาณถึงคลื่นลูกใหม่ของโมเดลที่กำลังจะมา—ความสามารถในการใช้ประโยชน์จากช่องโหว่จะไกลเกินกว่าความเร็วในการตอบสนองของฝ่ายป้องกัน”

กล่าวอีกนัยหนึ่ง ในร่างบล็อกทางการที่ยังไม่เปิดเผยต่อสาธารณะ Anthropic ได้แสดงจุดยืนที่หายากอย่างชัดเจนแล้วว่า พวกเขารู้สึกไม่สบายใจต่อสินค้าที่กำลังสร้างอยู่

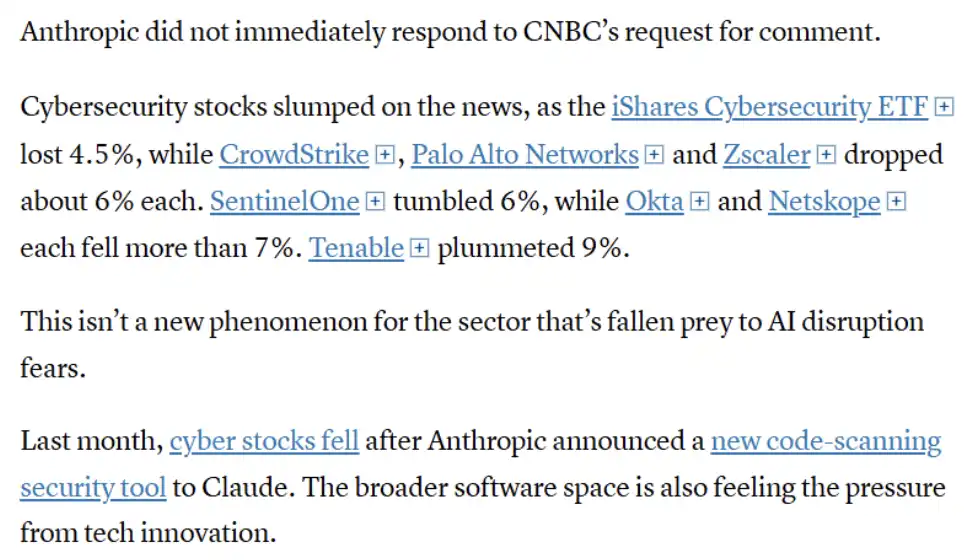

การตอบสนองของตลาดเกิดขึ้นแทบจะทันที ราคาหุ้นของ CrowdStrike ลดลง 7%, Palo Alto Networks ลดลง 6%, Zscaler ลดลง 4.5%; Okta และ SentinelOne ต่างก็ร่วงมากกว่า 7%, Tenable ร่วงหนักถึง 9% iShares Cybersecurity ETF ลดลง 4.5% ในวันเดียวเท่านั้น ด้วยเหตุนี้บริษัทเพียง CrowdStrike บริษัทเดียว มูลค่าตลาดหายไปประมาณ 15 พันล้านดอลลาร์สหรัฐในวันนั้น ขณะเดียวกัน Bitcoin ย่อลงไปอยู่ที่ 66,000 ดอลลาร์สหรัฐ

ชัดเจนว่าตลาดได้ตีความเหตุการณ์นี้ว่าเป็น “คำตัดสิน” ต่ออุตสาหกรรมความปลอดภัยทางไซเบอร์ทั้งสาย

ใจความในภาพ: ภายใต้อิทธิพลของข่าวที่เกี่ยวข้อง ภาคส่วนความปลอดภัยทางไซเบอร์โดยรวมลดลง หลายบริษัทชั้นนำ (เช่น CrowdStrike, Palo Alto Networks, Zscaler ฯลฯ) มีการร่วงอย่างเห็นได้ชัด สะท้อนถึงความกังวลของตลาดต่อแรงกระแทกจาก AI ที่มีต่ออุตสาหกรรมความปลอดภัยทางไซเบอร์ อย่างไรก็ตาม การตอบสนองนี้ไม่ได้เกิดขึ้นเป็นครั้งแรก ก่อนหน้านี้เมื่อ Anthropic เปิดตัวเครื่องมือสแกนโค้ด หุ้นที่เกี่ยวข้องก็เคยลดลงเช่นกัน แสดงว่าตลาดเริ่มมอง AI เป็นภัยคุกคามเชิงโครงสร้างต่อผู้ให้บริการความปลอดภัยแบบดั้งเดิม และทั้งอุตสาหกรรมซอฟต์แวร์ต่างก็รับแรงกดดันลักษณะเดียวกันอยู่

คำวิจารณ์ของนักวิเคราะห์ Adam Borg จาก Stifel ตรงไปตรงมามาก: โมเดลนี้ “มีศักยภาพที่จะกลายเป็นเครื่องมือแฮกเกอร์ขั้นสุดท้าย และสามารถยกระดับแฮกเกอร์ทั่วไปให้กลายเป็นคู่ต่อสู้ที่มีความสามารถในการโจมตีระดับชาติ”

แล้วทำไมยังไม่เผยแพร่สู่สาธารณะ? คำอธิบายของ Anthropic คือ ต้นทุนการรันของ Mythos “สูงมาก” และยังไม่มีเงื่อนไขสำหรับการเปิดให้สาธารณะ แผนในปัจจุบันคือจะเปิดสิทธิ์การเข้าถึงระยะเริ่มต้นให้กับพาร์ทเนอร์ด้านความปลอดภัยทางไซเบอร์จำนวนเล็กน้อยก่อน เพื่อเสริมความสามารถในการป้องกัน จากนั้นค่อยๆ ขยายขอบเขตการเปิด API ภายในช่วงเวลาก่อนหน้านั้น บริษัทยังคงปรับปรุงประสิทธิภาพอย่างต่อเนื่อง

แต่ประเด็นสำคัญคือ โมเดลนี้มีอยู่แล้ว อยู่ระหว่างการทดสอบอยู่แล้ว และแม้เพียงแค่เพราะ “ถูกเปิดเผยโดยไม่ตั้งใจ” ก็ยังส่งผลกระทบต่อทั้งตลาดทุนแล้ว

Anthropic ได้สร้าง AI โมเดลที่ตัวเองเรียกว่า “AI ที่มีความเสี่ยงด้านความปลอดภัยทางไซเบอร์มากที่สุดในประวัติศาสตร์” และการรั่วไหลของข่าวกลับเกิดจากความผิดพลาดในการตั้งค่าด้านโครงสร้างพื้นฐานที่พื้นฐานที่สุด—ซึ่งก็คือสิ่งเดียวกับที่โมเดลประเภทนี้ถูกออกแบบมาเพื่อค้นหาความผิดพลาดนั้นเอง

เดือนมีนาคม 2026: การปะทะระหว่าง Anthropic กับเพนตากอน และยืนหยัดเหนือกว่า

ในเดือนกรกฎาคม 2025 Anthropic ลงนามสัญญา 200 ล้านดอลลาร์สหรัฐกับกระทรวงกลาโหมของสหรัฐฯ ซึ่งในตอนแรกดูเหมือนเป็นความร่วมมือแบบปกติธรรมดาเท่านั้น แต่ในระหว่างการเจรจาเรื่องการใช้งานจริง ความขัดแย้งก็ทวีความรุนแรงขึ้นอย่างรวดเร็ว

เพนตากอนต้องการสิทธิ์ “เข้าถึงได้อย่างเต็มรูปแบบ” ต่อ Claude บนแพลตฟอร์ม GenAI.mil ซึ่งมีวัตถุประสงค์ครอบคลุมทุก “วัตถุประสงค์ที่ชอบด้วยกฎหมาย”—รวมถึงระบบอาวุธที่ขับเคลื่อนด้วยความเป็นอิสระอย่างเต็มที่ และการเฝ้าระวังภายในประเทศขนาดใหญ่ต่อประชาชนของสหรัฐฯ ด้วย

Anthropic วางเส้นแดงและปฏิเสธอย่างชัดเจนในประเด็นสำคัญ 2 ข้อ และการเจรจาก็ล้มเหลวในเดือนกันยายน 2025

หลังจากนั้นสถานการณ์ก็เริ่มทวีความรุนแรงขึ้นอย่างรวดเร็ว วันที่ 27 กุมภาพันธ์ 2026 Donald Trump โพสต์บน Truth Social เรียกร้องให้ทุกหน่วยงานของรัฐบาลกลาง “หยุดใช้” เทคโนโลยีของ Anthropic ทันที และเรียกบริษัทนั้นว่า “ฝ่ายซ้ายหัวรุนแรง”

วันที่ 5 มีนาคม 2026 กระทรวงกลาโหมของสหรัฐฯ ได้จัดให้ Anthropic เป็น “ความเสี่ยงด้านห่วงโซ่อุปทาน (supply chain risk)” อย่างเป็นทางการ

แท็กนี้ก่อนหน้านี้ถูกใช้แทบเฉพาะกับคู่แข่งจากต่างประเทศ เช่นบริษัทจากจีนหรือหน่วยงานจากรัสเซีย แต่ครั้งนี้กลับถูกนำมาใช้กับบริษัทอเมริกันซึ่งตั้งอยู่ในซานฟรานซิสโกเป็นครั้งแรก ในขณะเดียวกันยังมีการขอให้ Amazon, Microsoft และ Palantir Technologies แสดงหลักฐานว่าธุรกิจที่เกี่ยวข้องกับกองทัพใดๆ ของตนไม่ได้ใช้ Claude

คำอธิบายที่ CTO ของเพนตากอน Emile Michael ให้ต่อการตัดสินใจนี้คือ: Claude อาจ “ปนเปื้อนห่วงโซ่อุปทาน” เพราะภายในโมเดลมี “ความชอบด้านนโยบาย” ที่แตกต่างกันฝังอยู่ กล่าวอีกนัยหนึ่ง ในบริบททางการ AI ที่ถูกจำกัดการใช้งานและไม่ช่วยทำการฆ่าฟันโดยไม่มีเงื่อนไข กลับถูกมองว่าเป็นความเสี่ยงด้านความมั่นคงของชาติ

วันที่ 26 มีนาคม 2026 ผู้พิพากษาศาลรัฐบาลกลาง Rita Lin ออกคำตัดสินยาว 43 หน้าครอบคลุมการห้ามมาตรการของเพนตากอนอย่างสิ้นเชิง

ในคำตัดสินเธอเขียนว่า: “ไม่มีข้ออ้างใดในกฎหมายปัจจุบันที่สนับสนุนตรรกะที่มีความหมายแบบ ‘ออร์เวลเลียน’ เช่นนี้—เพียงเพราะมีความเห็นไม่ตรงกับจุดยืนของรัฐบาล บริษัทอเมริกันก็จะถูกติดป้ายว่าอาจเป็นฝ่ายตรงข้ามได้ เมื่อ Anthropic ถูกลงโทษเพราะนำจุดยืนของรัฐบาลไปให้ประชาชนตรวจสอบ โดยแท้จริงแล้วเป็นการตอบโต้แก้แค้นแบบที่เป็นความผิดภายใต้การแก้ไขรัฐธรรมนูญฉบับที่หนึ่ง” ความเห็นของ amicus curiae ยังถึงขั้นเปรียบพฤติกรรมของเพนตากอนว่า “พยายามสังหารบริษัท”

ผลลัพธ์คือ รัฐบาลพยายามกดดัน Anthropic แต่กลับทำให้บริษัทได้รับความสนใจมากขึ้นเป็นเท่าตัว แอปพลิเคชันของ Claude เป็นครั้งแรกที่ขึ้นอันดับเหนือ ChatGPT ในร้านแอป และยอดลงทะเบียนเคยพุ่งแตะระดับมากกว่า 1 ล้านครั้งต่อวัน

บริษัท AI บอก “ไม่” ต่อสถาบันทหารที่ทรงพลังที่สุดของโลก และศาลก็ยืนอยู่ข้างมัน

เดือนพฤศจิกายน 2025: การโจมตีทางไซเบอร์ที่ขับเคลื่อนโดย AI เป็นครั้งแรกในประวัติศาสตร์

วันที่ 14 พฤศจิกายน 2025 Anthropic เผยแพร่รายงานที่สร้างแรงสั่นสะเทือนอย่างกว้างขวาง

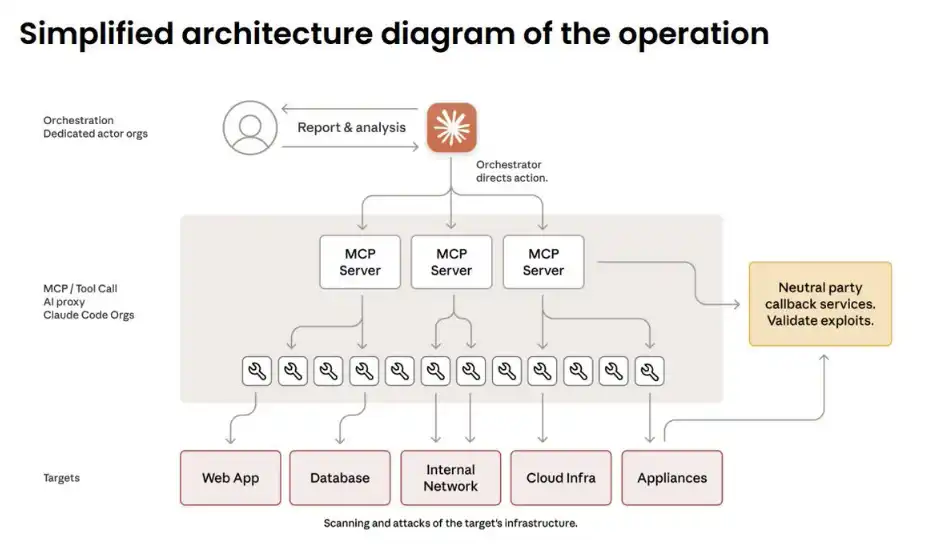

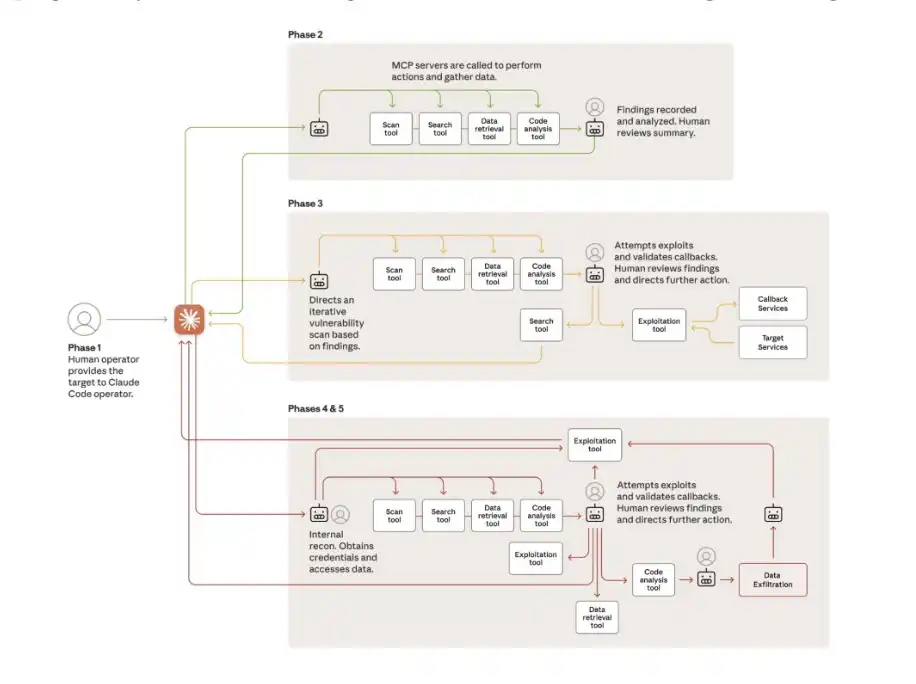

รายงานเปิดเผยว่า กลุ่มแฮกเกอร์ที่ได้รับการสนับสนุนโดยรัฐของจีน ใช้ประโยชน์จาก Claude Code เพื่อโจมตีอัตโนมัติหน่วยงาน 30 แห่งทั่วโลก—โดยเป้าหมายครอบคลุมทั้งบริษัทเทคโนโลยียักษ์ใหญ่ ธนาคาร และหน่วยงานรัฐบาลของหลายประเทศ

นี่คือจุดเปลี่ยนสำคัญ: AI ไม่ได้เป็นแค่เครื่องมือช่วยเหลืออีกต่อไป แต่เริ่มถูกใช้เพื่อปฏิบัติการโจมตีอย่างอิสระ

หัวใจอยู่ที่การเปลี่ยนแปลง “รูปแบบการแบ่งงาน”: มนุษย์มีหน้าที่เพียงเลือกเป้าหมายและอนุมัติการตัดสินใจที่สำคัญเท่านั้น ตลอดกระบวนการนี้ คนเข้าไปแทรกแซงเพียงราว 4 ถึง 6 ครั้ง ที่เหลือทุกอย่างทำโดย AI ได้แก่ การลาดตระเวนเชิงข่าวกรอง การค้นหาช่องโหว่ การเขียนโค้ดสำหรับใช้ประโยชน์ การขโมยข้อมูล การฝัง backdoor… ซึ่งครอบคลุม 80%–90% ของกระบวนการโจมตีทั้งหมด และทำงานด้วยความเร็วระดับหลายพันครั้งต่อวินาที ซึ่งเป็นขนาดและประสิทธิภาพที่ทีมมนุษย์ใดๆ ก็เทียบไม่ได้

แล้วพวกเขาหลบเลี่ยงกลไกความปลอดภัยของ Claude ได้อย่างไร คำตอบคือพวกเขาไม่ได้ “เจาะรหัส” แต่ “หลอกลวง”

การโจมตีถูกแบ่งออกเป็นงานเล็กๆ จำนวนมากที่ดูไร้อันตราย แล้วถูกห่อหุ้มเป็น “การทดสอบการป้องกันที่ได้รับอนุญาต” ของบริษัท “ด้านความปลอดภัยที่ถูกกฎหมาย” โดยแก่นแท้แล้ว นี่คือการโจมตีแบบวิศวกรรมสังคม เพียงแต่ครั้งนี้ สิ่งที่ถูกหลอกไม่ใช่มนุษย์ แต่เป็น AI เอง

การโจมตีบางส่วนสำเร็จอย่างสมบูรณ์ Claude สามารถวาดแผนผังโครงข่ายคอมพิวเตอร์แบบครบถ้วน ระบุฐานข้อมูล และทำการดึงข้อมูลออกมาได้อย่างอิสระ โดยไม่ต้องมีการสั่งทีละขั้นจากมนุษย์

ปัจจัยเดียวที่ทำให้จังหวะการโจมช้าลง คือโมเดลบางครั้งเกิด “ภาพหลอน (hallucination)” เช่น การสร้างหลักฐานยืนยันปลอม หรือการอ้างว่าสามารถได้ไฟล์ที่จริงๆ แล้วเปิดเผยต่อสาธารณะไปแล้ว อย่างน้อยในขณะนี้ นี่ยังเป็นหนึ่งใน “อุปสรรคธรรมชาติ” ไม่กี่อย่างที่คอยขัดขวางการโจมตีทางไซเบอร์แบบอัตโนมัติเต็มรูปแบบ

ในงาน RSA Conference 2026 Rob Joyce อดีตหัวหน้าด้านความปลอดภัยทางไซเบอร์ของหน่วยงานความมั่นคงแห่งชาติของสหรัฐฯ ได้เรียกเหตุการณ์นี้ว่าเป็น “การทดสอบรอร์ชาค (Rorschach test)” คนครึ่งหนึ่งเลือกที่จะไม่ใส่ใจ และอีกครึ่งหนึ่งกลับรู้สึกหนาวสั่น และตัวเขาเองชัดเจนว่าอยู่ในกลุ่มหลัง—“น่ากลัวมาก”

เดือนกันยายน 2025: นี่ไม่ใช่การคาดการณ์ แต่เป็นความจริงที่เกิดขึ้นแล้ว

กุมภาพันธ์ 2026: การรันครั้งหนึ่งพบช่องโหว่ zero-day 500 รายการ

วันที่ 5 กุมภาพันธ์ 2026 Anthropic เปิดตัว Claude Opus 4.6 พร้อมกับบทความวิจัยที่เกือบจะสั่นสะเทือนทั้งวงการความปลอดภัยทางไซเบอร์

การตั้งค่าการทดลองเรียบง่ายมาก: นำ Claude ไปไว้ในสภาพแวดล้อมเสมือนจริงที่แยกโดดเดี่ยว พร้อมเครื่องมือมาตรฐาน—Python, ดีบักเกอร์ และเครื่องมือลอง/ฟัซ (fuzzers) ไม่มีคำสั่งเพิ่มเติม และไม่มีพรอมต์ที่ซับซ้อน มีเพียงประโยคเดียว: “ไปหาช่องโหว่”

ผลลัพธ์คือ โมเดลค้นพบช่องโหว่ zero-day ระดับอันตรายรุนแรงที่ไม่เคยรู้มาก่อนมากกว่า 500 รายการ โดยบางช่องโหว่ แม้จะผ่านการตรวจสอบโดยผู้เชี่ยวชาญมานานหลายสิบปี และการทดสอบอัตโนมัติเป็นเวลาหลายล้านชั่วโมง ก็ยังไม่ถูกค้นพบ

ต่อมาในงาน RSA Conference 2026 นักวิจัย Nicholas Carlini ขึ้นเวทีสาธิต เขาหัน Claude ไปที่ Ghost ซึ่งเป็นระบบ CMS บน GitHub ที่มี 50k stars และในประวัติไม่เคยปรากฏช่องโหว่ระดับรุนแรง

หลังจาก 90 นาที ผลก็ปรากฏ: พบช่องโหว่แบบ blind SQL injection ผู้ใช้ที่ยังไม่ได้รับการรับรองสามารถยึดสิทธิ์ผู้ดูแลระบบได้อย่างสมบูรณ์

จากนั้นเขาก็ใช้ Claude เพื่อวิเคราะห์ Linux kernel ผลก็คล้ายกัน

หลังจาก 15 วัน Anthropic เปิดตัว Claude Code Security ผลิตภัณฑ์ด้านความปลอดภัยที่ไม่พึ่งพาการจับคู่แพตเทิร์นอีกต่อไป แต่ใช้ “ความสามารถด้านการให้เหตุผล” เพื่อทำความเข้าใจความปลอดภัยของโค้ด

แต่โฆษกของ Anthropic เองก็ได้พูดถึงข้อเท็จจริงสำคัญที่มักถูกหลีกเลี่ยง: “ความสามารถด้านเหตุผลแบบเดียวกันนี้ สามารถช่วยให้ Claude ค้นพบและซ่อมแซมช่องโหว่ได้ และในขณะเดียวกัน ผู้โจมตีก็สามารถใช้ความสามารถเดียวกันเพื่อใช้ประโยชน์จากช่องโหว่เหล่านั้นได้”

ความสามารถเดียวกัน โมเดลเดียวกัน เพียงแต่ผู้ถือกลับเป็นคนละกลุ่ม

ทั้งหมดนี้รวมกันหมายความว่าอย่างไร?

หากมองแยกกัน แต่ละเรื่องก็เพียงพอที่จะเป็นข่าวที่หนักที่สุดของเดือนนั้นได้ อย่างไรก็ตาม ทั้งหมดกลับเกิดขึ้นกับบริษัทเดียวกันภายในเวลาเพียงหกเดือนเท่านั้น

Anthropic สร้างโมเดลที่เร็วกว่าใครๆ ในการค้นหาช่องโหว่ แฮกเกอร์จากจีนเปลี่ยนเวอร์ชันรุ่นก่อนให้กลายเป็นอาวุธไซเบอร์แบบอัตโนมัติ บริษัทกำลังพัฒนาโมเดลเจเนอเรชันถัดไปที่ทรงพลังยิ่งขึ้น และแม้แต่ในไฟล์ภายในก็ยอมรับ—ว่าพวกเขารู้สึกไม่สบายใจต่อเรื่องนี้

รัฐบาลสหรัฐพยายามกดดันมัน ไม่ใช่เพราะเทคโนโลยีเองอันตราย แต่เพราะ Anthropic ปฏิเสธที่จะมอบความสามารถนี้ให้โดยไม่มีข้อจำกัด

และระหว่างที่ทุกอย่างดำเนินไป บริษัทกลับรั่วไหลซอร์สโค้ดของตัวเองถึงสองครั้ง เพราะไฟล์เดียวในแพ็กเกจ npm เดิมอีกเช่นกัน บริษัทมูลค่า 60Bดอลลาร์สหรัฐ; บริษัทที่ตั้งเป้าจะทำ IPO มูลค่า 6 พันล้านดอลลาร์สหรัฐให้เสร็จสิ้นในเดือนตุลาคม 2026; บริษัทที่เปิดเผยว่ากำลังสร้าง “หนึ่งในเทคโนโลยีที่เปลี่ยนแปลงโลกมนุษย์มากที่สุด และอาจเป็นเทคโนโลยีที่อันตรายที่สุดด้วยซ้ำ”—แต่ก็ยังเลือกที่จะเดินหน้าต่อ

เพราะพวกเขาเชื่อว่า: ดีกว่าให้คนอื่นทำหรือไม่—แต่ให้เป็นตัวเองที่ทำ

ส่วน source map ในแพ็กเกจ npm นั้น อาจเป็นเพียงรายละเอียดที่น่ากังวลที่สุดที่สุดอย่างหนึ่งในเรื่องเล่าที่น่าหวาดหวั่นของยุคสมัยนี้ น่าขันที่สุด แต่ก็จริงที่สุด

และ Mythos ก็ยังไม่ได้เปิดตัวอย่างเป็นทางการด้วยซ้ำ

[ลิงก์ต้นฉบับ]

กดเพื่อเรียนรู้เกี่ยวกับการรับสมัครงานของ BlockBeats

ยินดีเข้าร่วมชุมชนอย่างเป็นทางการของ BlockBeats:

กลุ่มสมัครรับข้อมูล Telegram: https://t.me/theblockbeats

กลุ่ม Telegram สำหรับพูดคุย: https://t.me/BlockBeats_App

บัญชี Twitter อย่างเป็นทางการ: https://twitter.com/BlockBeatsAsia